AI İLE GÖRSEL ÜRETİMDE TELİF RİSKLERİNİ YÖNETMEK VE GÜVENLİ ÜRETİM YAPMAK

AI ile birkaç dakika içinde kampanya görselleri, sosyal medya taslakları ya da ürün lansman görselleri üretmek mümkün. Asıl zor kısım ise hız değil; güvenle üretmek: kullanılan kaynakların lisansı, çıktının hak sahipliği, markaya benzerlik riski ve ekip içi onay akışı.

Bu yazıda “AI telif risk yönetimi” odağında, görsel üretim sürecini uçtan uca daha güvenli hale getiren yaklaşımı ele alacağız. Amaç; ekiplerin tasarım hızını düşürmeden, kanıtlanabilir bir üretim standardı oluşturmak ve olası itirazlarda hızlı yanıt verebilmek.

Odak noktası sadece hukuk değil; aynı zamanda operasyon, içerik stratejisi ve yazılım kullanım alışkanlıkları. Çünkü telif riski çoğu zaman tek bir hatadan değil, kayıt eksikliği, belirsiz lisans ve denetimsiz yayınlamadan doğuyor.

Risk haritasını çıkarıp süreç tasarlamak

İlk adım, “hangi risk türleri var?” sorusunu netleştirmek. Görsel üretimde risk, sadece telif ihlali değil; marka güvenliği, kişisel veri, yanıltıcı içerik ve sözleşmesel yükümlülükleri de kapsar. Bu yüzden riskleri bir harita gibi sınıflandırmak, hangi kontrolün nerede uygulanacağını belirlemek için kritiktir.

Telif, marka benzerliği ve stil taklidi ayırmak

AI çıktısı; telifli bir eseri birebir kopyalamasa bile, ayırt edici bir stile aşırı yaklaşarak “türetilmiş eser” tartışmasını doğurabilir. Ayrıca marka logolarına, ambalaj diline ya da karakter tasarımlarına benzerlik, reklam ve itibar riskini büyütür. Bu nedenle “telif” ile “marka benzerliği” kontrollerini ayrı katmanlar olarak kurgulamak gerekir.

Kullanım senaryosu bazlı onay akışı kurmak

Bir eğitim postu ile bir ürün lansmanı görselinin risk profili aynı değildir. Lansmanda daha sıkı bir kontrol gerekirken, dahili sunum görsellerinde farklı toleranslar uygulanabilir. Bu yaklaşım, hem hız kazandırır hem de gereksiz onay yükünü azaltır. Burada kritik nokta, her senaryo için ölçütleri yazılı hale getirip paylaşmaktır.

Lisans ve kaynak yönetimiyle iz bırakmak

Telif riskini azaltmanın en güçlü yolu, kaynağı belirsiz malzemeyi sürece sokmamaktır. AI ile görsel üretirken kullanılan referanslar, stok varlıklar, tipografi ve dataset kökeni görünmez bir borç yaratabilir. Bu borcu yönetmek için “kaynak ve lisans defteri” mantığıyla ilerlemek gerekir.

Stok içerik, font lisansı ve model lisansı eşlemek

Bir kompozisyon içinde stok bir ikon, lisanslı bir font ve AI tarafından üretilmiş bir arka plan aynı anda bulunabilir. Bu durumda sadece “çıktı AI’dan geldi” demek yetmez; kullanılan her bileşenin lisansı ayrı ayrı kontrol edilmelidir. Modelin kullanım koşulları, ticari kullanım izinleri ve kısıtları da bu paketin parçasıdır.

Creative Commons varyantlarını doğru yorumlamak

CC0, CC BY, CC BY-SA gibi Creative Commons seçenekleri benzer görünse de yükümlülükleri farklıdır. Örneğin atıf gerektiren bir içerik, reklam görselinde pratikte sorun çıkarabilir. Bu yüzden ekip içinde “hangi CC türleri hangi kullanımda kabul edilir?” kuralını önceden tanımlamak, son dakika krizlerini azaltır.

- Kaynak türü: stok, özgün çekim, illüstrasyon, AI çıktısı

- Lisans durumu: ticari kullanım, atıf şartı, yeniden dağıtım kısıtı

- Kullanım yeri: reklam, web, sosyal medya, sunum, e-posta

- Saklama kanıtı: fatura, sözleşme, lisans ekran görüntüsü, link

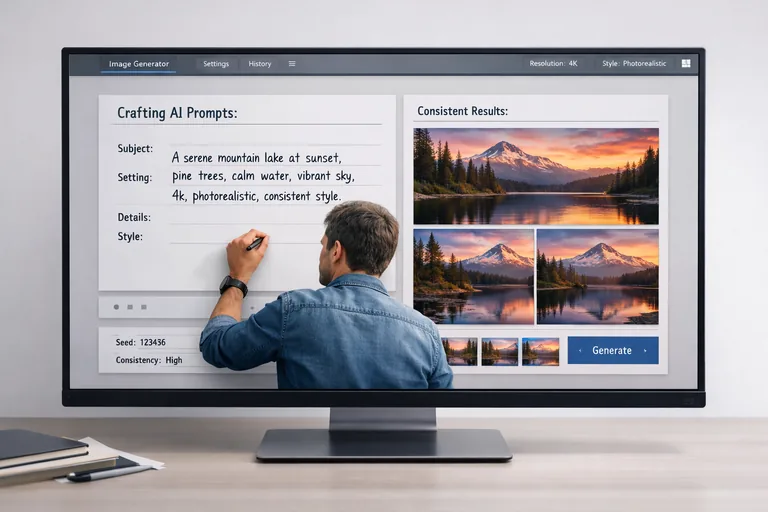

Prompt, referans ve çıktı kayıtlarını standardize etmek

Bir itiraz geldiğinde “bu görsel nasıl üretildi?” sorusuna hızlı yanıt verebilmek için kayıt şarttır. Kayıt derken sadece prompt metnini değil; kullanılan referansları, model sürümünü, parametreleri, iterasyonları ve nihai çıktının nerelerde kullanıldığını da kapsayan bir iz zinciri düşünün. Bu iz zinciri, hem ekip içi kaliteyi artırır hem de gerektiğinde hukuki değerlendirmeyi kolaylaştırır.

Prompt kayıtlarını versiyonlamak ve erişime açmak

Prompt’lar zamanla olgunlaşır; aynı işi farklı ekip üyeleri tekrar tekrar denemek zorunda kalmamalı. Bir prompt kütüphanesi oluşturup versiyonlamak, tutarlılık sağlar. Ayrıca “yasaklı terimler”, “marka adları”, “kişisel veri” gibi riskli girişlerin otomatik uyarı vermesi de süreç kalitesini yükseltir.

Referans kullanımını açıklamak ve sınır koymak

Referans kullanmak, kompozisyon ve ışık gibi genel nitelikleri hedeflemek için faydalıdır. Ancak birebir bir karakterin ya da özgün bir illüstrasyonun referans olarak yüklenmesi, risk seviyesini artırır. Bu nedenle “referans sadece stil değil, yapı ve içerik taşıyorsa risk artar” prensibini ekibe anlatmak; pratikte hataları azaltır.

Aşağıdaki örnek, üretim kaydını basit bir şema ile tutmak için kullanılabilir. Bu kayıt yapısı, iş akışına göre genişletilebilir.

{

"project": "2026-Q1-campaign",

"asset_id": "KV-hero-001",

"model": {

"name": "image-model-x",

"version": "1.8.2",

"provider_terms_checked": true

},

"prompt": {

"text": "Minimal product shot, neutral background, soft shadows, no logos, no text",

"negative": "brand, logo, watermark, celebrity, copyrighted character"

},

"references": [

{

"type": "internal_style_guide",

"id": "brand-color-palette-v3",

"notes": "Palette and typography only"

}

],

"license_notes": [

"No external stock used",

"Output reviewed for brand similarity and text artifacts"

],

"approvals": [

{"role": "designer", "name": "A.K.", "status": "approved"},

{"role": "marketing", "name": "E.S.", "status": "approved"}

],

"distribution": ["website-hero", "social-post-1080x1350"]

}Denetim katmanlarını otomatikleştirmek ve ölçmek

Manuel kontrol elbette gerekli; fakat tek başına sürdürülebilir değil. Güvenli üretim için denetimi katmanlara ayırmak ve mümkün olan yerlerde otomasyon eklemek gerekir. “Ön kontrol” aşamasında prompt ve referans filtreleri; “son kontrol” aşamasında çıktı taraması ve yayın öncesi onay mekanizması birlikte çalışmalıdır.

Watermark, metin hatası ve logo kalıntısı yakalamak

AI çıktılarında bazen anlamsız metinler, bozuk logolar ya da filigran benzeri izler oluşabilir. Bu izler, doğrudan bir ihlali kanıtlamasa da şüphe uyandırır ve yayın kalitesini düşürür. Bu nedenle görsel üzerinde metin tespiti (OCR), logo benzerliği taraması ve kalite kontrol checklist’i birlikte uygulanmalıdır.

Metadata denetimiyle izlenebilirlik sağlamak

Dosya metadata’sı; üretim kaynağı, edit geçmişi ve bazen kullanılan yazılım hakkında ipucu taşır. Bazı durumlarda yayın öncesi metadata temizliği gerekir; bazı durumlarda ise kanıt için saklamak gerekir. Bu ikilemi çözmek için “arşiv kopyası” ve “yayın kopyası” ayrımı yapmak iyi bir pratiktir.

Aşağıdaki kod, bir klasördeki dosyalar için basit bir hash üretip kayıt dosyasına yazmak üzere örneklenmiştir. Amaç; hangi çıktının hangi sürüm olduğunu sonradan doğrulayabilmektir.

import hashlib

import json

from pathlib import Path

def sha256_file(path: Path) -> str:

h = hashlib.sha256()

with path.open("rb") as f:

for chunk in iter(lambda: f.read(1024 * 1024), b""):

h.update(chunk)

return h.hexdigest()

folder = Path("exports")

manifest = {"files": []}

for p in folder.glob("*.webp"):

manifest["files"].append({

"name": p.name,

"sha256": sha256_file(p),

"size_bytes": p.stat().st_size

})

Path("export-manifest.json").write_text(json.dumps(manifest, ensure_ascii=False, indent=2), encoding="utf-8")

print("Manifest created:", len(manifest["files"]))Politika, eğitim ve rol paylaşımıyla sürdürülebilir olmak

Tek seferlik kontrol listeleri, ilk birkaç hafta işe yarar; sonra unutulur. Kalıcı etki için rol paylaşımı, kısa eğitim modülleri ve net sorumluluk gerekir. Tasarım, pazarlama ve hukuk aynı dili konuşmadığında, risk yönetimi “son dakika engeli” gibi algılanır. Oysa doğru kurguda bu süreç, üretimi hızlandıran bir standarda dönüşür.

Onay sorumluluklarını netleştirmek ve paylaştırmak

Kimin neyi onayladığı belirsizse, herkes “biri bakmıştır” diye düşünür. Bu yüzden sorumlulukları rol bazlı tanımlamak gerekir: tasarım kalite kontrolü, marka uygunluğu, telif/lisans kontrolü ve yayın onayı gibi adımlar ayrıştırılmalıdır. Ayrıca “riskli içeriklerde zorunlu ikinci göz” kuralı, hataları ciddi biçimde azaltır.

Kısa uygulamalarla ekip alışkanlığı kazandırmak

En iyi politika, uygulanandır. Ekiplerin günlük işine uyacak kısa pratikler; örneğin 15 dakikalık “prompt yazımı standardı”, 20 dakikalık “logo benzerliği kontrolü” ve 10 dakikalık “kayıt şablonu doldurma” gibi küçük modüllerle alışkanlık yaratılabilir. Bu eğitimler, yazılım kullanımında tutarlılık sağlar.

Bu noktada ekibin aynı yöntemle ilerlemesi için pratik odaklı bir eğitim planı oluşturmak isterseniz, AI görsel üretim eğitimi sayfasındaki kapsamı inceleyebilirsiniz. İçerik, üretim hızını korurken riskleri azaltmaya odaklanan iş akışlarını da ele alır.

Yayın sonrası izleme ve hızlı müdahale planı kurmak

En iyi önlem bile yüzde yüz garanti vermez. Bu yüzden yayın sonrası izleme ve müdahale planı, güvenli üretimin ayrılmaz parçasıdır. Bir bildirim geldiğinde kimin yanıt vereceği, hangi kanıtların sunulacağı ve hangi süre içinde aksiyon alınacağı önceden belirlenmelidir. Böylece kriz anında panik yerine prosedür işletilir.

İtiraz geldiğinde kanıt paketini hazırlamak

Kanıt paketi; üretim kaydı, kullanılan kaynakların lisansları, onay akışı ve dağıtım kanallarını içermelidir. Bu paket sayesinde “iyi niyetle üretildi” söylemi, somut veriye dönüşür. Ayrıca gerektiğinde çıktıyı hızlıca yayından kaldırma, alternatif üretme ve iletişim metni hazırlama adımları da bu pakete eklenmelidir.

Risk skorlamasıyla öğrenmek ve iyileştirmek

Her itirazı “tekil olay” gibi görmek yerine, risk skorlamasıyla ders çıkarmak daha faydalıdır. Örneğin marka benzerliği uyarısı alan işler, referans politikasını güncellemeyi gerektirebilir. Filigran benzeri izler artıyorsa, çıktı tarama aşaması güçlendirilebilir. Böylece süreç, her geri bildirimle olgunlaşır.

Güvenli üretim için pratik kontrol listesi oluşturmak

Uygulamada ekipler hızlı bir kontrol listesi ister. Aşağıdaki maddeler, günlük üretimde “son kapı” gibi kullanılabilecek bir çerçeve sunar. Kendi iş akışınıza göre sadeleştirip genişletebilirsiniz.

- Kaynak ve lisans net mi, belgesi saklandı mı?

- Prompt ve referans kayıtları dolduruldu mu, versiyonlandı mı?

- Logo/marka benzerliği ve metin kalıntısı kontrol edildi mi?

- Yayın senaryosu doğru seçildi mi, gerekli onaylar alındı mı?

- Arşiv kopyası ile yayın kopyası ayrıldı mı, hash kaydı alındı mı?

Özetle, AI ile üretimde güven; tek bir “kontrol” düğmesiyle değil, doğru tasarlanmış süreç, şeffaf kayıt ve ölçülebilir denetimle oluşur. Bu yaklaşım hem tasarım ekibinin hızını korur hem de karar vericilere daha öngörülebilir bir risk yönetimi sunar.